Скачать с ютуб WGAN implementation from scratch (with gradient penalty) в хорошем качестве

Скачать бесплатно WGAN implementation from scratch (with gradient penalty) в качестве 4к (2к / 1080p)

У нас вы можете посмотреть бесплатно WGAN implementation from scratch (with gradient penalty) или скачать в максимальном доступном качестве, которое было загружено на ютуб. Для скачивания выберите вариант из формы ниже:

Загрузить музыку / рингтон WGAN implementation from scratch (with gradient penalty) в формате MP3:

Если кнопки скачивания не

загрузились

НАЖМИТЕ ЗДЕСЬ или обновите страницу

Если возникают проблемы со скачиванием, пожалуйста напишите в поддержку по адресу внизу

страницы.

Спасибо за использование сервиса savevideohd.ru

WGAN implementation from scratch (with gradient penalty)

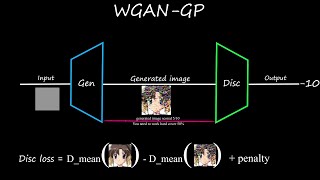

In this video we implement WGAN and WGAN-GP in PyTorch. Both of these improvements are based on the loss function of GANs and focused specifically on improving the stability of training. Resources and papers: https://www.alexirpan.com/2017/02/22/... https://arxiv.org/abs/1701.07875 https://arxiv.org/abs/1704.00028 ❤️ Support the channel ❤️ / @aladdinpersson Paid Courses I recommend for learning (affiliate links, no extra cost for you): ⭐ Machine Learning Specialization https://bit.ly/3hjTBBt ⭐ Deep Learning Specialization https://bit.ly/3YcUkoI 📘 MLOps Specialization http://bit.ly/3wibaWy 📘 GAN Specialization https://bit.ly/3FmnZDl 📘 NLP Specialization http://bit.ly/3GXoQuP ✨ Free Resources that are great: NLP: https://web.stanford.edu/class/cs224n/ CV: http://cs231n.stanford.edu/ Deployment: https://fullstackdeeplearning.com/ FastAI: https://www.fast.ai/ 💻 My Deep Learning Setup and Recording Setup: https://www.amazon.com/shop/aladdinpe... GitHub Repository: https://github.com/aladdinpersson/Mac... ✅ One-Time Donations: Paypal: https://bit.ly/3buoRYH ▶️ You Can Connect with me on: Twitter - / aladdinpersson LinkedIn - / aladdin-persson-a95384153 Github - https://github.com/aladdinpersson OUTLINE: 0:00 - Introduction 0:27 - Understanding WGAN 6:53 - WGAN Implementation details 9:15 - Coding WGAN 15:50 - Understanding WGAN-GP 18:48 - Coding WGAN-GP 25:29 - Ending

![[DeepLearning | видео 1] Что же такое нейронная сеть?](https://i.ytimg.com/vi/RJCIYBAAiEI/mqdefault.jpg)